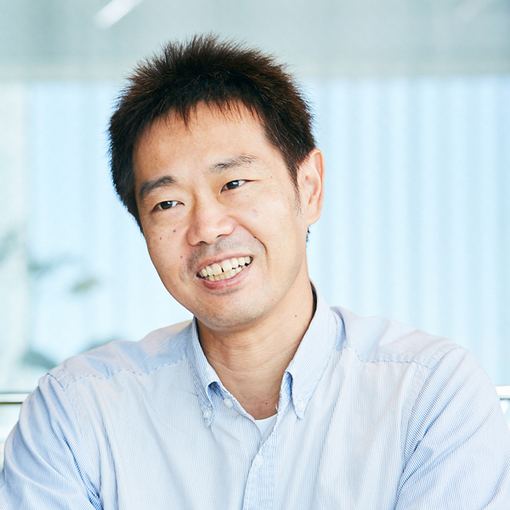

データ・クリエイティブ対談【第6弾】 AIで人を騙す、信頼を得るには。(前編) ゲスト:東京大学 鳥海不二夫准教授

データ・クリエイティブの進化の在り方について、博報堂DYグループ社員と識者が語り合う『データ・クリエイティブ対談』。第6弾のゲストは、東京大学の鳥海不二夫准教授です。「人狼」というゲームへのAI技術の適用を通じて、AIで人を騙す、信頼を得ることを研究している鳥海准教授に、AIの現状や今後果たすべき役割などについてうかがいました。聞き手は博報堂DYメディアパートナーズの篠田裕之です。

- 篠田

- 今回、鳥海先生が研究されている「人狼知能」にとどまらず、AI全般について、たくさんお聞きしたいことがあります。

まずは、鳥海先生の著書『強いAI・弱いAI 研究者に聞く人工知能の実像』というタイトルにもなっている、強いAI、弱いAIについてご説明いただいてもよろしいでしょうか。

- 鳥海

- 強いAIというのは、意識を持ったAI、つまりSFに出てくるような人工知能を指しています。まだ作れる見込みのないようなものですね。

弱いAIというのは、今世の中にあるようなAI一般を指しています。今現在AIと呼ばれているものは全て弱いAIです。

一応、人狼についても知らない方のためにご説明すると、人狼は味方のフリをしたうそつきを会話で見つけるゲームです。村人は協力して人狼が誰かを推理し、村から追放していきます。うそをついたり、推理したり、説得したり、といった駆け引きが醍醐味のゲームです。

- 篠田

- 人狼知能が面白いなと思ったのは「人を騙す」ためのAI活用だからです。

鳥海先生が、以前「正しいことの追求にAIが使われることがよくあるが、正しさを追求しないAIもあるんじゃないか」と仰っていて、私もそこに非常に関心があります。

人を騙す上で必要なのは「信頼を得る」こと

- 篠田

- そもそも先生が人工知能や社会科学に興味を持たれたきっかけを教えていただけますか。

- 鳥海

- もともと人間の集団の動きに興味がありました。人間の動きには、ミクロなものから社会現象まで幅がありますが、我々は個人個人が自分の意思で自由に行動を決めているにも関わらず、「流行」のような社会全体としての動きが生まれてきます。人間個人のミクロでシンプルな動きしか規定しなくても全体として大きな動きに繋がることに興味があるんです。

人間を扱う研究という事で、卒論で計量心理学をやり始めて、それで博士号まで取ったのですが、人間は言うことを聞いてくれないことに気が付いて(笑)。アンケートで質問に答えてくれってお願いしても、空欄があったりとか。 そこで「コンピュータだったら言うこと聞いてくれる」と思って、データから人間の行動から社会の動きを理解する研究に移りました。

- 篠田

- なるほど、面白いですね。人狼に着目されたのは何故でしょうか。

- 鳥海

- 2010年くらいに当時研究室の学生だった現電気通信大学の稲葉先生と人狼を遊んでいるときに「人狼の研究をやろう」っていう話になりました。人狼は、人間の嫌らしい部分が出てきたりするので面白いですよね。

人狼同士が結託する、といった行動をAIで取り組むものとして面白そうでしたし。

当時は、まだ将棋や囲碁でもAIが人には勝っていなかったんですが、そろそろ勝つだろうなと言われていました。そうなると、次にAIで挑むゲームを考えてもいいんじゃないかと思い、人狼ならばAIで実現するのに様々な技術が必要であることが予想できたので、研究テーマとしてふさわしいなと。

将棋は1対1で行い、盤面にゲームに必要な情報が全て現れている「完全情報ゲーム」と言われるものなんです。一方で人狼は、他対他のチーム戦だし、その局面を見てもどんな状況かは分からない不完全情報ゲームだし、自由度が高くリアルタイム性があるし・・・ととにかく囲碁や将棋と違う点が多いんですね。

特に人狼が他と違う大きな点がコミュニケーション性です。人を騙す場合に、嘘を付くことが重要なのではなくて、信頼を勝ち取ることが重要なのです。人は「いかに自分の言っていることを信じてもらうか」に力を注ぐわけですが、今までのAIは信用されるのは当たり前のことで、あんまりテーマになっていなかったんですね。

でも人狼AIは、発言を信じてもらうための努力がいる。人間のコミュニケーションと同じように、対立する意見が出てきたら自分を信じてもらうように工夫しないと信じてもらえないわけです。

さらに、逆に人間がAIに対して嘘を言ってくる、ということはこれまで考慮する必要がある場面はほとんどなかったと思います。でも人狼でなくても、いずれAIが発展してくれば人間が嘘を伝えて利益を得ようとすることがあるかもしれません。そういうケースに備えるためにも、人狼にAIを使う研究は役立てられる可能性があると思っています。

- 篠田

- 我々の仕事は、広告主、そしてその先の生活者の心を動かす、ということなので、信頼を得るためのフローがどのようなものかは非常に興味があります。

一方でAIが嘘を伝えて人を騙すようになる可能性に備える、というお話は近年のフェイクニュースやアドフラウドに関連して、広告・メディア業界としても考えていかなければいけないことだと思います。

AIにとって「雑談」はハードルが高い

- 篠田

- 「機械学習」はマーケティングにおいても様々な活用がされています。例えば需要予測、広告配信の最適化、サイトでの商品推薦、チャットボット、広告の自動生成などです。

これらは人間が課題を与えて処理をするので、先生の言葉で言えば、弱いAIかと思います。

- 鳥海

- 強いAI弱いAIの区別もそうですが、AIと言う言葉は幅広いため、何を指すのかを明確にしないと変に誤解されたりしますよね。例えば、チャットボットと推薦は、どちらもAIと呼んでいますがほぼ別物です。例えば、チャットボットは対話エージェント、推薦をするためのAIはレコメンデーションシステムと呼んだ方が、誤解が無いように思います。無理にでもAIと言いたい場合は別ですが(笑)

- 篠田

- そうですね。今後マーケティングで活用されているものが強いAIとなっていく可能性、例えば対話エージェントが強いAIになる可能性についてはどう思いますか。

- 鳥海

- 非常に難しいですね。今実用化されているチャットボットは機械学習+ルールベースがメインです。基本的にはタスク指向型と呼ばれる、例えば宅配ピザの応答に使うような対話の目的が明確なものしかありません。これだと多彩な対応を取る必要はなくて、変なことを言われた場合は「分かりません」でいい。

一方で、非タスク指向型と呼ばれる、簡単に言えば雑談をするエージェントは、何を言っても適切に返す必要があるんですが、これが難しくまだ実用化できているとは言えないですね。

タスク指向型のほうは昔からあるし、精度は上がってきてはいますが、まだまだ技術としては発展途上です。分かりやすいので、凄いと言われやすいですが。

タスク指向型にせよ非タスク指向型にせよ、強いAIに直接繋がるかというと、まだまだ道は遠いといった感じです。

- 篠田

- リビングに置いてあるスマートスピーカーと自然に会話できるか、といったことの方が難しいということですよね。

- 鳥海

- そうですね。本当はスマートスピーカーと雑談ができればいいのですが、実際には特定のタスクをこなす会話くらいしかできません。

たしかに、データが凄く増えて、ネットからいつでもデータにアクセスできるようにもなったので、完全なルールベースでなくても質問に答えることができるようになっては来ています。例えば、「日本で2番目に高い山は何?」といったことには知識ベースで答えられます。不動産について「どこどこ駅付近でいい家はない?」といった質問にも、ある程度は答えられるでしょう。

そういった質問応答システムなんかは精度が向上してきていますが、それでも雑談は難しいんです。心地よく相槌を打つ、といったことなら上手くできるかもしれませんが。

- 篠田

- 討論はいかがですか。

- 鳥海

- テーマとスタンスが明確なら可能かもしれないですね。課題が決まると作り込みでいけちゃうと思います。一方で、お題を決めずに汎用的なものを作るとなると難しいでしょう。その場その場に応じて適切な行動を取れるようにするとか、想定されていない状況にいかに対応するかっていうことが必要になります。

自然言語のテキスト情報で嘘は見破れる

- 篠田

- 人狼の研究では、まずは定型文をスタティックに決めてやっていると思うんですが、ニュアンスなんかはどうなんでしょうか。語尾や話す勢いも、嘘を言っているかどうかの判断に関わるように思うのですが。

- 鳥海

- 調べてみた限りでは、「語尾がこうなったから信頼できる」といった直接の因果関係が無いみたいです。また、一緒に研究している心理学の先生が調べたところによると「嘘が見抜ける」と言っている人狼の上級者と、人狼の初心者では、嘘を見抜く割合はあまり変わらないそうです。嘘を付いている人の外見的な特徴、例えばまばたきが増える、といったよく言われるようなことも実際には無く、外見から嘘を見抜くのも難しいということです。

最初、我々はWeb上で人狼をやった記録を分析することから始めました。Webでやる人狼の中には、参加者がボイスチェンジャーのような機能を使って、与えられた役割に声質を変えてやり取りするものもありますが、我々はテキストだけで人狼を行う人狼BBSのデータを用いました。データを分析して気づいたんですが、結構プレイヤーは誰が嘘を付いているか高い精度で当てているんですね。このデータにはテキストデータしか含まれていないにも関わらず、です。だから、「嘘かどうかを自然言語のテキスト情報だけからも見抜くことはできる」という結論に至りました。表情やニュアンスなどの対面対話ならではの様々な情報とは関係なく嘘を見抜くこともできるようなんですね。

- 篠田

- 外見やニュアンスからは嘘が見抜けない、というのはとても意外ですね。一方でSNSやチャットなどによって、ニュアンスを理解することの重要性も高まっていますよね。例えば、返答のタイミングとか絵文字の有る無しなんかで、相手の反応を推測したり。

- 鳥海

- 私はAILLという婚活サービス会社の顧問をやっているんですが、その会社では男女をマッチングさせた後に、対話をスムーズに進めるためのアドバイスを行っているんです。そこでは、まさに会話の分析をして「このタイミングでこう返したほうがいいですよ」といったアドバイスをするAIの開発をしていますが、こういった場合はニュアンスをうまく推定できないとアドバイスもできません。今後、このような人間のコミュニケーションを支援するようなAIが増えるにしたがって、ニュアンスを理解するという技術は重要になってくるでしょうね。

この記事はいかがでしたか?

-

鳥海 不二夫(とりうみ ふじお)1976年5月生まれ。2004年、東京工業大学大学院理工学研究科機械制御システム工学専攻博士課程修了(博士(工学))、同年名古屋大学情報科学研究科助手、2007年同助教、2012年東京大学大学院工学系研究科准教授。計算社会科学、人工知能技術の社会応用などの研究に従事。

鳥海 不二夫(とりうみ ふじお)1976年5月生まれ。2004年、東京工業大学大学院理工学研究科機械制御システム工学専攻博士課程修了(博士(工学))、同年名古屋大学情報科学研究科助手、2007年同助教、2012年東京大学大学院工学系研究科准教授。計算社会科学、人工知能技術の社会応用などの研究に従事。

情報法制研究所理事。人狼知能プロジェクト代表。人工知能学会、電子情報通信学会、情報処理学会、日本社会情報学会、AAAI各会員。

「科学技術への顕著な貢献2018(ナイスステップな研究者)」

主な著書に『強いAI・弱いAI 研究者に聞く人工知能の実像』『人狼知能 だます・見破る・説得する人工知能』。

-

博報堂DYメディアパートナーズ

データビジネス開発局データサイエンティスト。自動車、通信、教育、など様々な業界のビッグデータを活用したマーケティングを手掛ける一方、観光、スポーツに関するデータビジュアライズを行う。近年は人間の味の好みに基づいたソリューション開発や、脳波を活用したマーケティングのリサーチに携わる。