AIで「流行りの曲」は作れるのか?~AI作詞作曲プロジェクトからの気づき~【デジノグラフィ・トーク vol.25】

博報堂生活総合研究所(以下、生活総研)では、2022年、各年代の日本のヒット曲に高頻度で登場するワードや曲調などを反映した「ヒンド(頻度)ソング」を、AIによる作詞・作曲で制作しました。

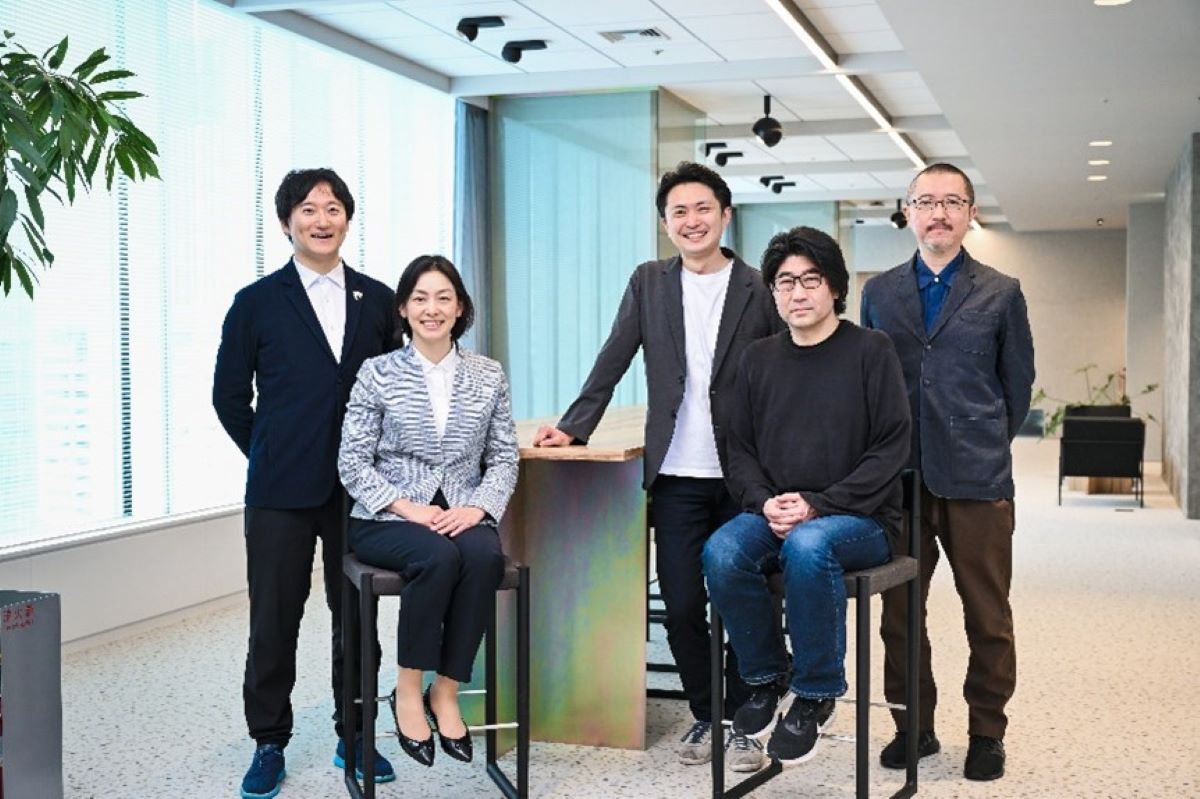

今回は、この「ヒンドソング」プロジェクトのメンバーである亜細亜大学教授の堀玄先生、株式会社インビジの高木公知さん、米田望さん、そして生活総研の酒井崇匡、佐藤るみこが再結集し、「AI時代の音楽創作」について語り合います。

亜細亜大学 経営学部 データサイエンス学科 教授

堀 玄

株式会社インビジ 音楽プロデューサー

高木 公知

株式会社インビジ 作曲家

米田 望

博報堂生活総合研究所 上席研究員

酒井 崇匡

博報堂生活総合研究所 上席研究員

佐藤 るみこ

◆AI作詞の「不気味の谷」

- 酒井

- 昨年、ここにいるメンバーで手掛けた「ヒンドソング」プロジェクトは、新聞や情報番組など様々なメディアで取り上げられるなど、各方面から大きな反響をいただきました。

私たちメンバーとしても、AIを活用した音楽の創作について、それぞれに気づきや手ごたえを得たと思います。

その振り返りを通じて、「未来の音楽創作」のあり方を展望していこうというのが、今回の座談会のねらいです。

まずは、プロジェクトにおける各メンバーの役割を簡単に紹介しておきましょう。

最初に、生活総研の酒井と佐藤が、歌詞の時系列分析から、各年代のヒットソングに特徴的な「高頻度ワード」を特定しました。

続いて、堀先生が開発されたAI作詞システムを活用し、それぞれの高頻度ワードを含めることを条件として、年代ごとの歌詞を作成しました。

こうして出来上がった歌詞に、インビジの高木さんと米田さんがAIによる自動作曲システムでメロディをつけ、さらに人の手で編曲してレコーディングする……という流れでした。

瞳、髪など80年代の高頻度ワードを使ったヒンドソング『夏恋リクエスト』

さて、このプロジェクトを通じて、みなさんは実際にどんなことを感じられたでしょうか?

- 堀

- プロジェクトの依頼をいただいたのが、ChatGPTが登場する少し前だったんですよね。時期的には2021年の秋くらい。なので、このとき使ったのは、「BERT」という自然言語処理モデルです。

僕は、2015年にもNHKのプロジェクトでAIによる作詞を手掛けたことがあるのですが、このとき使ったのは、当時としては最新だった「Word2Vec」という言語処理モデルでした。

BERTはWord2vecと比べるとはるかに精度が上がったといいますか、自然な文章を生成することができます。ただ、自然になり過ぎて、逆に細部がきちんとしていないと作品にならない。そこが少し苦労した点です。

Word2vecを使っていた頃は、一応ワードは並んでいるんだけど、ちょっとヘンな日本語の文章が出てきたりするので、かえってそれを面白がることができたんです。

- 酒井

- アンドロイドやアバターでは、人間に近づきすぎるとかえって不自然に感じられるという「不気味の谷」現象がありますが、AI作詞にも似たような壁があったということでしょうか。

- 堀

- そうですね。不気味だし、あと本当に普通の日本語なので、細部がちゃんとしてないと許されないレベルになってしまったなと感じました。「2015年のプロジェクトのときより歌詞の質が上がりましたね」と評価していただいたのは嬉しかったんですけどね。

◆AIを使うために人の手間が増した?

- 佐藤

- AI作曲を担当いただいたインビジのおふたりはいかがでしたか?

- 高木

- 作曲には「ORPHEUS(オルフェウス)」という自動作曲システムを使ったのですが、AIにメロディをつくってもらった経験はなかったので、最初はかなり戸惑いました。

AIに歌詞をインプットしたら、自動的に全部作曲をしてくれるのかなと思っていたのですが、そういうことでもなくて。

最終的には、年代に応じてアレンジをどうしたいのかを想定してコード進行を設定しなくてはならなかったり、意外とこちらの問いかけの質の高さが問われるので、それが逆に面白いと感じました。

最近、ChatGPTを遊びで使ってみても、同じことを思います。AIは何でもできるけど、いいものを出せるのはこちらがいい質問をしたときなんですよね。

世紀末のダークなトーンを加えた90年代のヒンドソング『夜を抱きしめて』

- 米田

- ChatGPTが登場した今となっては、余分な作業も多かったように思います。

歌詞が異なるとAIがつくるメロディも異なるので、歌詞のフレーズを何パターンも用意して結果をテストするのですが、そういった場合もChatGPTなら「バリエーションを書いて」と言うだけで済んだだろうなと。

結局、要素としてAIが出してきたものは利用できるけれど、それを組み立てて曲として成立させるには、人の手が介在しないと難しい。それによって、こちらの行程はいくらか増えてしまう。

- 酒井

- なるほど。AIが作業をラクにしてくれたというよりも、AIを使うために苦労した部分のほうが大きいと。

- 米田

- ただ、ChatGPTが出てきて、また状況は変わっているのかもしれません。これからは、AIがつくってきたものをちょっと手直しすれば使える時代になるんじゃないか。

ORPHEUSにしても、僕らはあくまでお手伝いさんというポジションで、AIがつくったメロディはいじらないというルールでやっていたのですが、本当はメロディも直せたらがぜんよくなったはず。そんな感じでうまくAIとコラボレーションしていく時代が、いよいよやってきたのではないでしょうか。

不況下で模索を続ける世相を反映した00年代ヒンドソング『明日を待てば』

◆AIの上手な使い方

- 高木

- 僕が想像しているこれからのAIの使い方というのは、制作のすべてをお願いするというより、自分が制作していて行き詰まる瞬間はたくさんあるので、そんなときに「こうしたいんだけど、どうすればいい?」という相談相手や助手のような存在になってほしいですね。

自分だけでつくったものって、自分の想像の範囲をあまり超えなくて、そこに誰か人でもAIでも自分にはない発想が入った瞬間に良くなるということは多々あります。そういう使い方ができれば理想的なのではないでしょうか。

- 堀

- ChatGPTは助手だという指摘は鋭いですね。例えば、仕事をはじめるのがすごく億劫なときに、とりあえずAIにやらせてみるといいかもしれません。もちろん、そのままでは使えないでしょうが、AIが出してきたものを直すのは、自分で1行目から書くよりもずっと精神的にラクそうです。

- 高木

- 「自分だったらこうする」というのが、発想のひとつの取っ掛かりになりますからね。

- 酒井

- 自分が書いたものについて、「ここはこう直したほうがいい」みたいにチェックしてくれるという役割も期待できそうですね。

- 堀

- いわゆる書き直しですよね。雑に書いた文章を入れて、「丁寧な文章に直して」と言うと、そういうのは本当にちゃんとやってくれます。

アイドルの楽曲をイメージした10年代のヒンドソング『キミにずっと』

◆AIは日本語で韻を踏めない

- 酒井

- 一方で、現段階でAIの限界を感じる点はありますか?

- 堀

- ChatGPTに歌詞をつくらせると、英語だと韻が踏めるけれど、日本語だと踏めないという話があります。

英語の場合、例えば~ing、~ingになっていれば韻が踏めていますよね。ところが日本語の場合、字面と音の対応が複雑で、ひとつの漢字で何通りもの読み方があったりする。

膨大な数の歌詞について、漢字で書いたものとひらがなの読み方のデータを作成し、それを学習させれば、AIにも日本語で韻が踏めるようになるかもしれません。

ただ、今の大規模言語モデルのように、自然にネット上の言語を学習するだけでは、永遠にできるようにはならないんじゃないかと思います。

- 高木

- 音楽的に、韻を踏めないのはかなりの痛手ですよね。

韻を踏めることのメリットは、ひとつには母音を縛れること。歌詞に無数の選択肢があるなかで、母音の縛りがあることによって、そこに創作者のワードチョイスのセンスが表れる。それが、その作品の個性になるわけです。

もうひとつは、やはり音楽というのはある種の繰り返しによって気持ちよさや高揚感を表現するものなので、言葉のほうでも韻を踏むことで、その繰り返しの感じをさらに強調できるんです。

- 米田

- 例えば「愛」という言葉があるとしますよね。その「アイ」を何回言えるかで、音楽で伝えられるメッセージの強度が決まる。

つまり、いろいろなことを言うのが音楽の目的じゃない。好きだ、好きだ、愛だ、愛だと似たような意味合いのことを繰り返す。あるいはアイに聞こえるようなことを繰り返し言っていく。反復こそが音楽の本質だから、韻はとても重要なんですよ。

- 高木

- 実例を挙げるとOfficial髭男dismの『Pretender』は、韻を平歌からサビにかけてたくさん踏んでいて、それがすごく気持ちいい楽曲です。

- 堀

- そうですね。『Pretender』の歌詞の中には「ストーリー」と「通り」という単語で韻を踏む箇所があるのですが、「ストーリー」は最後に伸びるけれど、「通り」は本来伸びない。でも後者を歌うときにも「とおりー」と伸ばして、つまりルールを破って韻を踏んでいるんです。こういう芸当はChatGPTには相当難しいんじゃないかと思いますね。

ちなみに、ChatGPTに「この歌詞にコード進行付けて」というと、ちゃんと「ド・ファ・ソ・ド」みたいになっていて、コード進行はこう始まったらこう終わらなくちゃいけないという原則を守って作ってくれます。それは、素直にすごいなと思いました。

ただ、進行の仕方が無難すぎて、やや物足りなさを感じてしまう。何とかしたくて、「ジャズ風にして」とかいろいろ言ってみるんだけど、現状ではなかなかそこまではうまくいかないですね。

- 酒井

- 「面白さ」をプロンプトできるのかというのは、興味深い視点ですね。やはりその部分は、現状では人が手を入れるしかないのでしょうね。

◆AIがつくる音楽の二次創作文化

- 米田

- 音楽方面のAIで個人的に気になっているのは、「Ultimate Vocal Remover」でボーカルと楽器を分離できるようになったことと、それらを「Diff-SVC」に学習させることで、ボーカルの入れ替えが可能になったことです。いずれも基本無料のAIツールですが、こうしたツールを活用することで、これからは世の中に音楽の二次創作があふれるだろうと思います。

ちょっとこちらを聴いてみてください。ご存じ、ビートルズの「Help!」です。ボーカルのメインはジョン・レノンですが、この音声データをUltimate Vocal Removerで処理すると……。

- 酒井

- アカペラになりましたね!

- 米田

- そうなんです。声だけ抜くことができるんです。

次に使うのが、AI版ボイスチェンジャーと呼ばれているRVC (Retrieval-based-Voice-Changer) です。これに、ジョン・レノンのボーカルを学習させ、さらに別の人間の声のデータも学習させると、まったく別人が歌った「Help!」が完成するというわけです。

置き換える側の声のデータは2時間ほどあると理想的らしいのですが、僕が試してみたところ、5分くらいの音源でもなんとかなりました。

これってすごくクリエイティブだし、聴いてみたいじゃないですか。なんなら自分版の「Help!」もつくっちゃおうみたいな、いろいろな可能性が見えてきたんですよね。

- 佐藤

- 学生が遊びの延長でやるようになれば、無数に二次創作が出てきそうですね。

- 米田

- 現在の著作権法では権利者の許諾なしにこういったものを制作して配布することはアウトですが、法律や使用料の分配などのインフラ整備を進めることで解決できる問題だと思うんです。むしろ今、そういったインフラ側の準備が行われていないことのほうが問題だと僕は思いますね。こんなにも創造的で音楽を躍進させるような発明は、後にも先にもありません。

◆音楽の「ループ」が崩壊していく

- 米田

- コード進行のトレンドって、何年かに1回でループしているんですよ。なので今回、自分が担当した2020年代のヒンドソングも、ちょうどレトロブームや90年代ブームが盛り上がる中で再流行してきていたコード進行を編曲の際に取り入れてあるんです。

再流行したコードを取り入れた20年代のヒンドソング『声が響く世界で』

そして今後は AIの技術がそのような流行のループをなくしてしまうんじゃないかと思っています。

「ヒンドソング」プロジェクトでは、それぞれの年代を狙った曲をAIと共作しましたよね。いまのAIの能力ではまだ無理かもしれないけれど、そのうちプロンプト一発で「95年の曲」というのがポンと出せるようになるかもしれない。このやり方なら、いかようにも時代を超越できるじゃないですか。

- 酒井

- すごく面白い話ですね。この1月に、生活総研では「消齢化」という現象について発表したんです。要するに、年代や年齢による価値観や嗜好の違いが小さくなっているということですね。例えばJOYSOUNDのカラオケデータでいうと、10年前に比べて「全年代で歌える曲」が爆発的に増えているんですよ。

- 堀

- そのとおりだと思います。

昔、僕が学生だった頃って、あるものがカッコいいということになると、そうじゃないものがダサいということになって、それがしばらく続くんです。そして5年くらいすると、今度はダサいとされていたものがカッコよくなって、それまでカッコよかったものがダサくなる。

それがいつの頃からか、どれがカッコよくてどれがダサいということではなく、ある人たちはずっとこれを聴いていて、別の人たちはほかの何かを聞くようになった。まさに、年代のループの崩壊ですね。

- 高木

- 音楽でいうと、やはり昔は音楽番組がたくさんあって、毎週のようにヒット曲が出ていて、みんながそれを観ていたから、そこに評価が集中していたのでしょうね。

今はインターネットで好きなものを聴けるようになったから、「別にダサいと思われようが俺は好きだ」という絶対評価になる。

- 酒井

- 2017年ぐらいに、10歳から14歳くらいの子たちを取材したことがあるんです。

彼らはSNSネイティブだし、スマホネイティブでもあるのですが、そのときすごく感じたのは「データベースは人の興味の垣根を崩すんだな」ということです。

YouTubeを使っていると、昔の曲もリコメンドされますよね。すると、小4や小5の子どもたちがBEGINを好きになって聴きまくっているということが、普通に起こるんですよ。

AIによる音楽制作は、この「消齢化」の流れを加速させるかもしれないですね。

- 佐藤

- AI時代の音楽のあり方について、様々な可能性が見通せたように思います。本日はありがとうございました。

この記事はいかがでしたか?

-

堀 玄亜細亜大学 経営学部 データサイエンス学科 教授専門分野は数理工学・音楽情報処理。自動作曲システムOrpheusの開発などに携わる。著書に「プログラミングのための線形代数」(共著)など。

堀 玄亜細亜大学 経営学部 データサイエンス学科 教授専門分野は数理工学・音楽情報処理。自動作曲システムOrpheusの開発などに携わる。著書に「プログラミングのための線形代数」(共著)など。

-

高木 公知株式会社インビジ 音楽プロデューサー2009年インビジ(有限会社インビジブル・デザインズ・ラボ)入社。 CMの楽曲制作をメインの業務として行う傍ら、カンヌ国際広告祭で広告賞を受賞したdocomo「森の木琴」ではテクニカルディレクターとして木琴製作を行うなど従来の音楽制作にとらわれない音楽の体験拡張を行なっている。

高木 公知株式会社インビジ 音楽プロデューサー2009年インビジ(有限会社インビジブル・デザインズ・ラボ)入社。 CMの楽曲制作をメインの業務として行う傍ら、カンヌ国際広告祭で広告賞を受賞したdocomo「森の木琴」ではテクニカルディレクターとして木琴製作を行うなど従来の音楽制作にとらわれない音楽の体験拡張を行なっている。

-

米田 望株式会社インビジ 作曲家広告やエンターテイメントの映像作品のサウンドトラックを制作している作曲家。トラディショナルなジャズ理論を学んだ後に、サンプリングなどを多用する現代的なスタイルのアーティスト活動を経験。様々なスタイルを融合させたハイブリッドな楽曲を幅広く創り出している。

米田 望株式会社インビジ 作曲家広告やエンターテイメントの映像作品のサウンドトラックを制作している作曲家。トラディショナルなジャズ理論を学んだ後に、サンプリングなどを多用する現代的なスタイルのアーティスト活動を経験。様々なスタイルを融合させたハイブリッドな楽曲を幅広く創り出している。

-

博報堂生活総合研究所 上席研究員2005年博報堂入社。マーケティングプラナーを経て、12年より現職。 デジタル空間上のビッグデータを活用した生活者研究の新領域「デジノグラフィ」を様々なデータホルダーとの共同研究で推進中。 行動や生声あるいは生体情報など、可視化されつつある生活者のデータをもとにした発見と洞察を行っている。 新刊に『デジノグラフィ インサイト発見のためのビッグデータ分析』(共著) https://www.amazon.co.jp/dp/4883355101/その他の著書に『自分のデータは自分で使う マイビッグデータの衝撃』(星海社新書)がある。

-

博報堂生活総合研究所 上席研究員2004年博報堂入社。

営業として、飲料、食品、製薬、化粧品など様々な企業の戦略立案・広告制作・メディアセールスなどに携わる。3年間の産休・育休を経て2019年から現職。